2025-04-01:MIPL的1篇论文被TPAMI 2025接收

北京科技大学和MIPL有1篇合作论文被接收,研究动作质量评估。

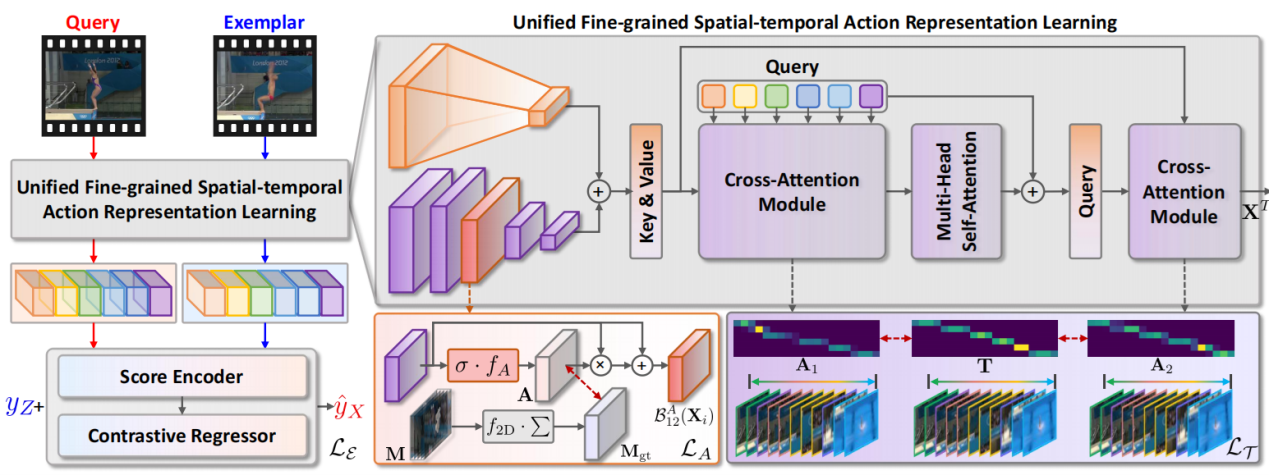

以人为中心的细粒度动作质量评估方法

Human-centric Fine-grained Action Quality Assessment

作者:徐婧林,尹思博,彭宇新

通讯作者:彭宇新

论文链接:https://ieeexplore.ieee.org/document/10946879

源代码链接:https://github.com/PKU-ICST-MIPL/Uni-FineParser_TPAMI2025

人体动作质量评估(Action Quality Assesment,AQA)旨在量化视频中人体动作的完成质量,得到质量分数。不同于传统动作质量评估,细粒度动作质量评估需要对视频中动作的时间过程和空间位置进行细粒度解析,以得到准确的动作质量分数。现有方法通常直接由整段视频编码得到质量分数,缺乏对视频中动作的细粒度解析,导致质量分数预测不准确。

本文方法是CVPR 2024工作“FineParser: A Fine-grained Spatio-temporal Action Parser for Human-centric Action Quality Assessment”的扩展研究,发表于TPAMI 2025。针对上述挑战,本文提出了统一的前景动作表征学习框架Uni-FineParser,在时间和空间维度同时对动作进行细粒度解析,将动作划分为多个连续的动作步骤,并学习以人为中心的前景动作表征,降低背景区域带来的干扰,相比于FineParser同时提升了精度和速度。本文方法具体贡献如下:(1)动作空间解析(Spatial Action Parsing),设计了一个掩码引导的动作注意力模块,用以捕捉目标动作区域,增强视觉主干网络对人体动作的感知能力;(2)动作时间解析(Temporal Action Parsing),设计了类似 DETR 的时间解码器,引入可学习的子动作查询向量,建模目标动作连续步骤之间的时间关系;(3)静态视觉编码(Static Visual Encoding),通过二维视觉主干网络提取每一帧的视觉特征,丰富动作表征的语义信息;(4)本文为AQA-7 数据集构建了以人为中心的前景动作掩码标注,并设计了新的基准测试AQA-7-HM。本文方法在动作质量评价数据集FineDiving-HM、 MTL-AQA和AQA-7上进行了全面的对比实验和消融实验,实验结果显示了方法的有效性。

该论文的第一作者是北京科技大学徐婧林副教授,通讯作者是彭宇新教授。