2024-10-28:MIPL师生参加 ACM MM 2024

2024年10月28日至11月1日,ACM国际多媒体大会(ACM International Conference on Multimedia,ACM MM 2024)在澳大利亚墨尔本召开。MIPL刘洋助理教授、硕士生王梓烁参加了此次会议。

ACM MM每年召开一次,是CCF A类推荐的国际多媒体领域顶级会议,涵盖多媒体内容理解、生成等各专业领域。本次会议共收到4340篇有效投稿,最终录用1149篇,录用率为26.47%。会议包括学术论坛、主题报告和墙报展示等环节。

本次大会MIPL共有6篇论文发表,信息如下:

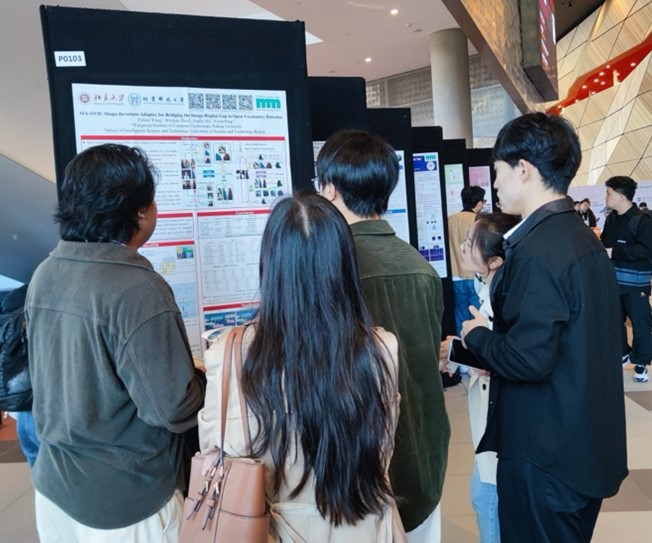

[1] Zishuo Wang, Wenhao Zhou, Jinglin Xu and Yuxin Peng*, "SIA-OVD: Shape-Invariant Adapter for Bridging the Image-Region Gap in Open-Vocabulary Detection", 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28 - Nov. 1, 2024.

本论文针对开放词汇目标检测(Open-Vocabulary Detection,OVD)中,图像-区域差异导致目标检测框分类准确率较低的问题,提出形状不变性适配器(Shape-Invariant Adapter,SIA)方法。首先,本论文探讨了图像-区域差异的来源,观察到检测框的形状对分类效果有明显的影响,“刀”、“领带”、“滑雪板”等细长形状的类别的分类效果较差。本论文认为现有方法使用RoIAlign进行特征裁剪后不同形状的特征图均被压缩为正方形,导致目标物体的形状特征被破坏,CLIP无法正确识别。因此,本论文提出形状不变性适配器方法以缓解上述图像-区域差异:维护由多个特征适配器网络组成的集合,其中每一个适配器处理检测框长宽比在一个固定范围内的区域特征,将其映射回CLIP能够识别的未形变特征,从而提高对目标检测框的分类准确率,进而取得了更好的开放词汇目标检测性能。

王梓烁同学墙报展示

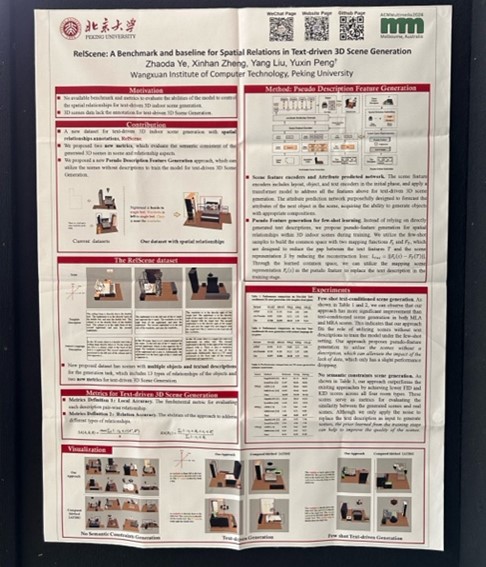

[2] Zhaoda Ye, Xinhan Zheng, Yang Liu and Yuxin Peng*, "RelScene: A Benchmark and baseline for Spatial Relations in text-driven 3D Scene Generation", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对当前文本驱动的三维场景生成任务所面临的标注缺失与数据不足问题,首先扩展了已有的场景数据集3D-FRONT,为每一个场景构建了模板化描述与自然语言描述两种形式的场景标注。同时构建了2个新评价指标,从场景局部一致性与关系类别一致性两个角度评价生成的三维场景。此外,还提出了基于隐空间语义建模的小样本三维场景表示学习,通过构建三维场景特征与文本描述特征的统一映射空间,将无标注的三维场景投射到统一空间后,采样获得相应的伪文本描述特征用于文本到三维场景生成的模型训练,提高生成模型的生成效果与语义一致性。

叶钊达同学墙报展示

[3] Minghang Zheng, Jiahua Zhang, Qingchao Chen, Yuxin Peng and Yang Liu*, "ResVG: Enhancing Relation and Semantic Understanding in Multiple Instances for Visual Grounding", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对当图像中存在大量干扰对象时准确定位目标对象困难的问题,提出了一种全新的关系和语义敏感的视觉定位(ReSVG)模型。首先,本论文提出已查询文本作为提示词,利用预训练文生图模型生成和查询语义匹配的参考图像作为模型输入,增强模型对目标对象细粒度属性的理解。其次,本论文提出了一种关系敏感的数据增强方法,通过合成包含多个相同类别对象的图像并基于它们空间关系构造伪查询来生成额外的训练数据。本论文所提出的ReSVG模型对物体语义和空间关系有着更好的理解,显著提高了在具有多个同类别干扰实例场景中的视觉定位性能。本论文在五个数据集上进行了广泛的实验来验证本论文方法的有效性。

[4] Zichen Liu, Yuxin Peng and Jiahuan Zhou*, "InsVP: Efficient Instance Visual Prompting from Image Itself", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对传统“预训练-微调”范式存储和计算开销巨大的问题,提出了一种基于原始图像的高效实例级视觉提示学习方法,以全面和高效地利用单个实例的判别性特征。具体而言,本论文首先提出实例级图像提示,从原图中提取关键和细微的判别性信息,并叠加到输入图像上。此外,本论文提出实例级特征提示,以捕捉不同实例之间的共性和特性,输入到模型的中间层促进特征提取。上述实例级图像提示和特征提示协同互补,增强预训练模型对单个实例判别性特征的提取能力。在多个大规模基准上的实验表明,本论文方法在参数成本更低的同时,达到领域先进水平的性能。

[5] Kunlun Xu, Haozhuo Zhang, Yu Li, Yuxin Peng and Jiahuan Zhou*, "Mitigate Catastrophic Remembering via Continual Knowledge Purification for Noisy Lifelong Person Re-Identification", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对现有LReID模型在利用噪声标签数据学习时发生显著性能下降的问题,提出了一种基于灾难性记忆知识持续净化的噪声终身行人重识别方法,在克服模型对错误知识灾难性记忆的同时,缓解其对正确知识的灾难性遗忘。首先提出基于聚类感知的数据净化模块,通过挖掘样本细粒度共享信息实现错误标注数据剔除。其次提出迭代标签修正策略,通过在训练过程中融合预测结果和原始标注来纠正错误标签。最后,提出错误知识过滤模块,通过估计旧模型特征知识的正确性,利用加权的知识蒸馏损失将正确旧知识传递给新模型。此外,本论文提出一个噪声终身行人重识别数据集并开展了大量实验。实验结果表明,本论文方法在不同噪声水平和噪声类型下均能显著提升模型对噪声标签数据的终身学习能力。

[6] Qiwei Li, Yuxin Peng and Jiahuan Zhou*, "PPE: Progressive Prototype Evolving for Dual-Forgetting Mitigation in Non-Exemplar Online Continual Learning", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对在线持续学习阶段间遗忘的问题,提出了一种基于原型进化的无样本保留在线持续学习方法,核心思想是在在线学习阶段逐步学习各个类别的原型特征,将类别原型特征作为类别知识进行保留,而不保留任何先前学习的样本。同时,本论文充分利用当前批次样本对应的原型中积累的知识,指导模型分类头的训练,以缓解阶段内遗忘的问题。此外,本论文引入了原型相似性约束损失和原型指导的梯度约束模块,通过原型特征中保留的历史知识来约束模型学习的学习过程,以抵抗阶段间遗忘的问题。实验结果表明,本论文方法在三个常用数据集以及不同的持续学习场景下均达到了领域先进水平。

ACM MM每年召开一次,是CCF A类推荐的国际多媒体领域顶级会议,涵盖多媒体内容理解、生成等各专业领域。本次会议共收到4340篇有效投稿,最终录用1149篇,录用率为26.47%。会议包括学术论坛、主题报告和墙报展示等环节。

MIPL师生会场合影(左1:王梓烁,右1:刘洋助理教授)

本次大会MIPL共有6篇论文发表,信息如下:

[1] Zishuo Wang, Wenhao Zhou, Jinglin Xu and Yuxin Peng*, "SIA-OVD: Shape-Invariant Adapter for Bridging the Image-Region Gap in Open-Vocabulary Detection", 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28 - Nov. 1, 2024.

本论文针对开放词汇目标检测(Open-Vocabulary Detection,OVD)中,图像-区域差异导致目标检测框分类准确率较低的问题,提出形状不变性适配器(Shape-Invariant Adapter,SIA)方法。首先,本论文探讨了图像-区域差异的来源,观察到检测框的形状对分类效果有明显的影响,“刀”、“领带”、“滑雪板”等细长形状的类别的分类效果较差。本论文认为现有方法使用RoIAlign进行特征裁剪后不同形状的特征图均被压缩为正方形,导致目标物体的形状特征被破坏,CLIP无法正确识别。因此,本论文提出形状不变性适配器方法以缓解上述图像-区域差异:维护由多个特征适配器网络组成的集合,其中每一个适配器处理检测框长宽比在一个固定范围内的区域特征,将其映射回CLIP能够识别的未形变特征,从而提高对目标检测框的分类准确率,进而取得了更好的开放词汇目标检测性能。

[2] Zhaoda Ye, Xinhan Zheng, Yang Liu and Yuxin Peng*, "RelScene: A Benchmark and baseline for Spatial Relations in text-driven 3D Scene Generation", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对当前文本驱动的三维场景生成任务所面临的标注缺失与数据不足问题,首先扩展了已有的场景数据集3D-FRONT,为每一个场景构建了模板化描述与自然语言描述两种形式的场景标注。同时构建了2个新评价指标,从场景局部一致性与关系类别一致性两个角度评价生成的三维场景。此外,还提出了基于隐空间语义建模的小样本三维场景表示学习,通过构建三维场景特征与文本描述特征的统一映射空间,将无标注的三维场景投射到统一空间后,采样获得相应的伪文本描述特征用于文本到三维场景生成的模型训练,提高生成模型的生成效果与语义一致性。

[3] Minghang Zheng, Jiahua Zhang, Qingchao Chen, Yuxin Peng and Yang Liu*, "ResVG: Enhancing Relation and Semantic Understanding in Multiple Instances for Visual Grounding", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对当图像中存在大量干扰对象时准确定位目标对象困难的问题,提出了一种全新的关系和语义敏感的视觉定位(ReSVG)模型。首先,本论文提出已查询文本作为提示词,利用预训练文生图模型生成和查询语义匹配的参考图像作为模型输入,增强模型对目标对象细粒度属性的理解。其次,本论文提出了一种关系敏感的数据增强方法,通过合成包含多个相同类别对象的图像并基于它们空间关系构造伪查询来生成额外的训练数据。本论文所提出的ReSVG模型对物体语义和空间关系有着更好的理解,显著提高了在具有多个同类别干扰实例场景中的视觉定位性能。本论文在五个数据集上进行了广泛的实验来验证本论文方法的有效性。

[4] Zichen Liu, Yuxin Peng and Jiahuan Zhou*, "InsVP: Efficient Instance Visual Prompting from Image Itself", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对传统“预训练-微调”范式存储和计算开销巨大的问题,提出了一种基于原始图像的高效实例级视觉提示学习方法,以全面和高效地利用单个实例的判别性特征。具体而言,本论文首先提出实例级图像提示,从原图中提取关键和细微的判别性信息,并叠加到输入图像上。此外,本论文提出实例级特征提示,以捕捉不同实例之间的共性和特性,输入到模型的中间层促进特征提取。上述实例级图像提示和特征提示协同互补,增强预训练模型对单个实例判别性特征的提取能力。在多个大规模基准上的实验表明,本论文方法在参数成本更低的同时,达到领域先进水平的性能。

[5] Kunlun Xu, Haozhuo Zhang, Yu Li, Yuxin Peng and Jiahuan Zhou*, "Mitigate Catastrophic Remembering via Continual Knowledge Purification for Noisy Lifelong Person Re-Identification", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对现有LReID模型在利用噪声标签数据学习时发生显著性能下降的问题,提出了一种基于灾难性记忆知识持续净化的噪声终身行人重识别方法,在克服模型对错误知识灾难性记忆的同时,缓解其对正确知识的灾难性遗忘。首先提出基于聚类感知的数据净化模块,通过挖掘样本细粒度共享信息实现错误标注数据剔除。其次提出迭代标签修正策略,通过在训练过程中融合预测结果和原始标注来纠正错误标签。最后,提出错误知识过滤模块,通过估计旧模型特征知识的正确性,利用加权的知识蒸馏损失将正确旧知识传递给新模型。此外,本论文提出一个噪声终身行人重识别数据集并开展了大量实验。实验结果表明,本论文方法在不同噪声水平和噪声类型下均能显著提升模型对噪声标签数据的终身学习能力。

[6] Qiwei Li, Yuxin Peng and Jiahuan Zhou*, "PPE: Progressive Prototype Evolving for Dual-Forgetting Mitigation in Non-Exemplar Online Continual Learning", The 32nd ACM International Conference on Multimedia (ACM MM), Melbourne, Australia, Oct. 28-Nov. 1, 2024.

本论文针对在线持续学习阶段间遗忘的问题,提出了一种基于原型进化的无样本保留在线持续学习方法,核心思想是在在线学习阶段逐步学习各个类别的原型特征,将类别原型特征作为类别知识进行保留,而不保留任何先前学习的样本。同时,本论文充分利用当前批次样本对应的原型中积累的知识,指导模型分类头的训练,以缓解阶段内遗忘的问题。此外,本论文引入了原型相似性约束损失和原型指导的梯度约束模块,通过原型特征中保留的历史知识来约束模型学习的学习过程,以抵抗阶段间遗忘的问题。实验结果表明,本论文方法在三个常用数据集以及不同的持续学习场景下均达到了领域先进水平。