跨媒体检索

跨媒体检索旨在以任意媒体数据检索其他媒体的相关数据,实现图像、文本等不同媒体的语义互通和交叉检索。课题组围绕跨媒体检索的研究包括跨媒体统一表征、相似性计算等,也包括跨媒体索引构建。具体的应用场景包括:

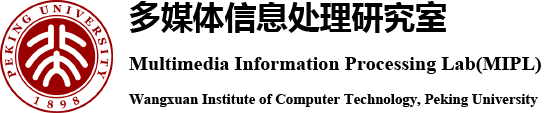

1. 跨媒体搜索引擎:通过跨媒体检索技术能够实现一种全新的检索方式,即任意给定一张图像,可通过跨媒体检索技术,得到与查询图像语义相似的图像、视频、文本、音频、图形等不同媒体的检索结果。

2. 报社出版社:跨媒体检索技术能够帮助编辑寻找素材,自动关联和推荐与稿件相关的多媒体素材。

|

组内相关论文

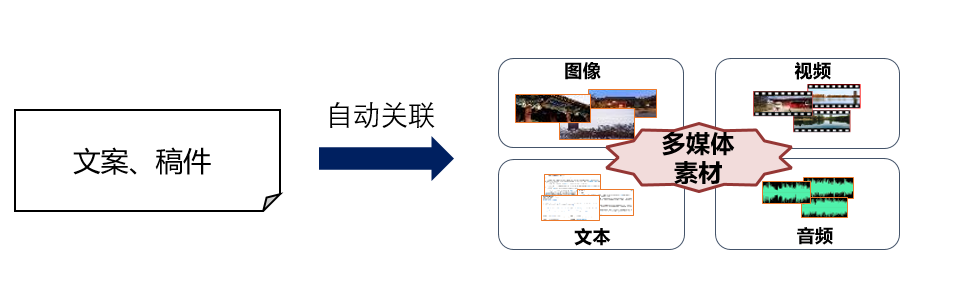

1.针对深度跨媒体统一表征学习,提出了跨媒体生成式对抗网络,构建跨媒体卷积自编码器,通过媒体内和媒体间的对抗训练拟合不同媒体数据的联合分布,提升了跨媒体关联学习的效果[1]。

方法流程图

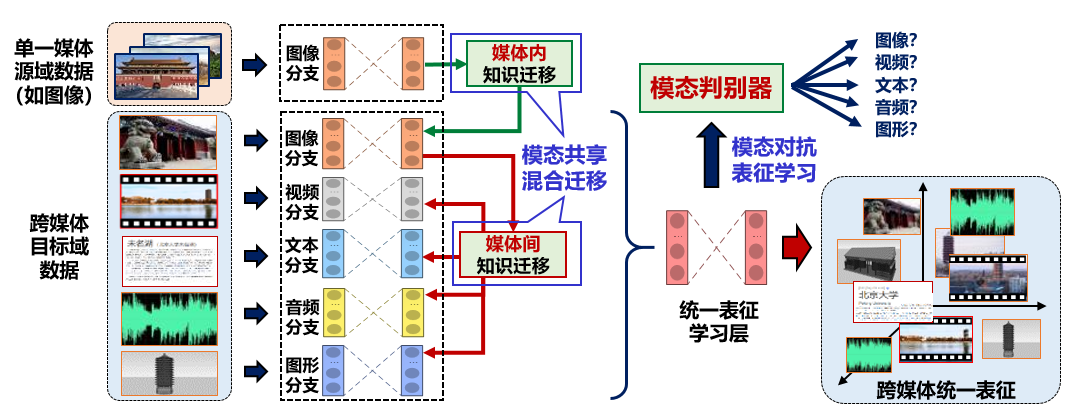

2.针对跨媒体数据标注成本大的问题,提出混合知识迁移方法,通过模态共享的混合迁移网络与模态对抗的表征学习策略,仅使用包含单一媒体的源域数据,支持跨媒体目标域的模型训练[2]。

方法流程图

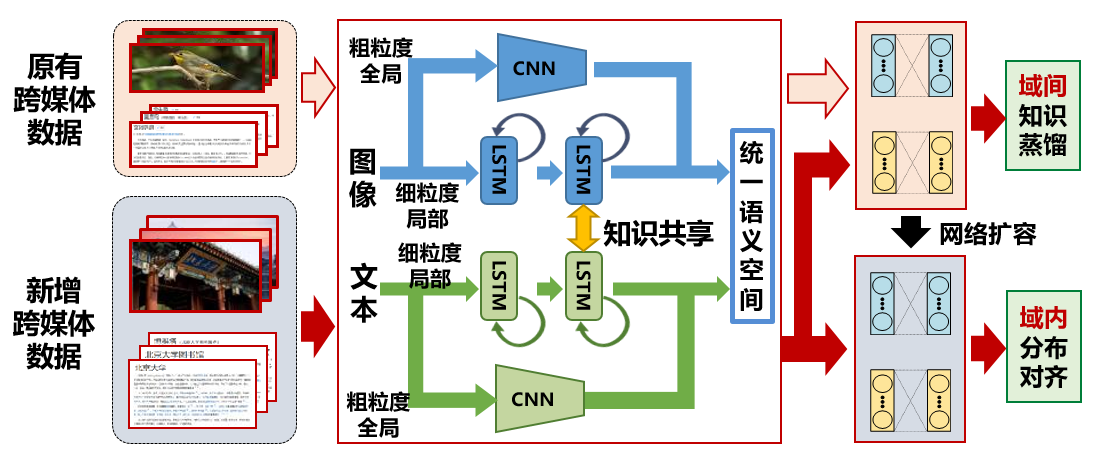

3.针对新增跨媒体数据的模型训练问题,提出了跨媒体终身学习方法,建立高层知识共享及自适应网络扩容机制,通过域内分布对齐和域间知识蒸馏,利用知识迁移促进新增数据关联学习[3]。

方法流程图

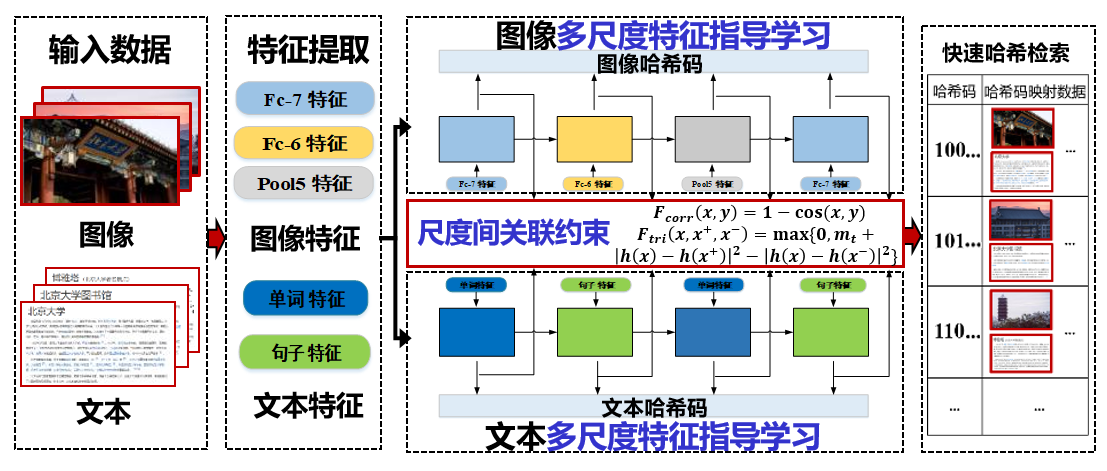

4.针对跨媒体哈希学习,提出序列化多尺度特征哈希方法,通过多尺度特征指导学习和尺度间关联挖掘,提高了哈希码的多样性和鲁棒性,实现更好的检索结果[4]。

方法流程图

[1] Yuxin Peng and Jinwei Qi, "CM-GANs: Cross-modal Generative Adversarial Networks for Common Representation Learning", ACM Transactions on Multimedia Computing, Communications, and Applications (TOMM), Vol. 15, No. 1, p. 22, Feb. 2019.

[2] Xin Huang and Yuxin Peng, "Deep Cross-media Knowledge Transfer", 31st IEEE Conference on Computer Vision and Pattern Recognition (CVPR), pp. 8837–8846, Salt Lake City, Utah, USA, Jun. 18-22, 2018.

[3] Yuxin Peng, Jinwei Qi, Zhaoda Ye and Yunkan Zhuo, "Hierarchical Visual-Textual Knowledge Distillation for Life-Long Correlation Learning", International Journal of Computer Vision (IJCV), Vol. 129, No. 4, pp. 921-941, Apr. 2021.

[4] Zhaoda Ye and Yuxin Peng, "Multi-Scale Correlation for Sequential Cross-modal Hashing Learning", 26th ACM Multimedia Conference (ACM MM), pp. 852-860, Seoul, Korea, Oct. 22-26, 2018.